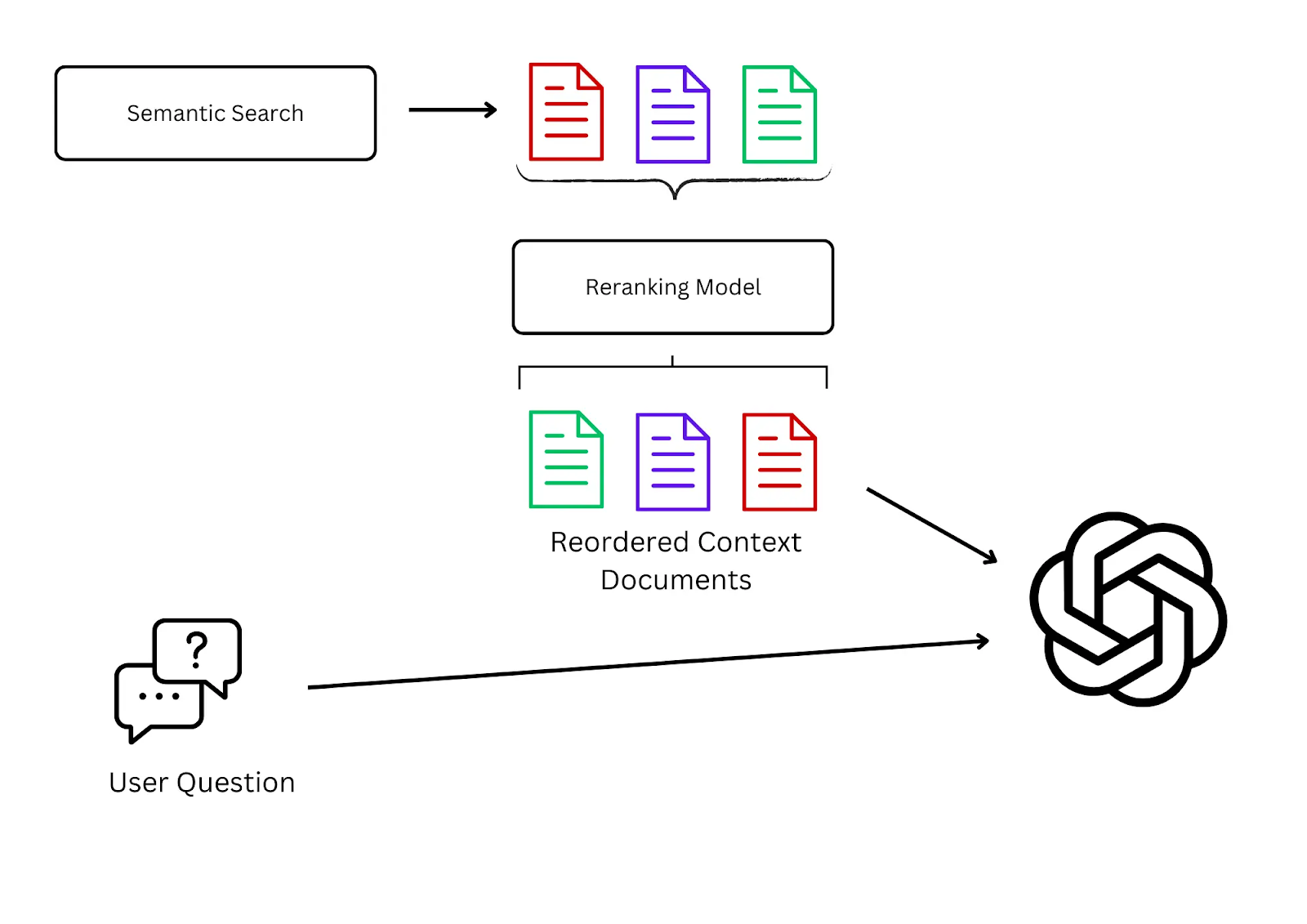

Em um pipeline de geração aumentada de recuperação (RAG), um recuperador busca um conjunto de documentos candidatos usando um filtro grosso por meio de uma pesquisa de similaridade vetorial. Quando estes documentos são recuperados, não são ordenados, pelo que poderá ser utilizado um documento menos relevante antes de outro mais relevante.

É aqui que aplicamos modelos de reclassificação, que oferecem uma segunda passagem no processo de recuperação para classificar o texto recuperado por relevância semântica em relação à consulta do usuário.

Você pode obter uma compreensão intuitiva dos reclassificadores pensando nos mecanismos de pesquisa. Ao pesquisar algo no Google, esperamos que os resultados mais relevantes sejam exibidos na primeira página. À medida que avançamos nas páginas seguintes, a relevância dos resultados em relação à consulta diminuiria.

Como os reclassificadores melhoram a qualidade da recuperação

O reclassificador pode melhorar significativamente a qualidade da pesquisa porque opera em nível de subdocumento e subconsulta. Utiliza um modelo mais preciso, como um transformador que lê conjuntamente a consulta e o documento para examinar os textos candidatos.

O processo de reclassificação é simples:

- Recuperar: Primeiro, um sistema de pesquisa usa incorporações de vetores para encontrar um amplo conjunto de documentos potencialmente relevantes com base na consulta do usuário.

- Analisar: Em seguida, o reclassificador pega esses resultados e analisa seu conteúdo semântico considerando as nuances de como os termos da consulta interagem com o conteúdo do documento.

- Reordenar: Por fim, o modelo reordena os resultados da pesquisa, colocando no topo os que considera mais relevantes, com base nesta análise mais aprofundada.

O ecossistema de IA oferece uma variedade de ferramentas comerciais e de código aberto que podem ajudar a melhorar os pipelines RAG usando reclassificadores. Na seção a seguir, apresentaremos algumas opções para implantação de reclassificadores, seguidos de ferramentas comerciais e de código aberto.

Como implantar reclassificadores

Reclassificadores são modelos autônomos que devem ser executados de forma independente. Você pode optar por implantar e executar o modelo diretamente ou consumi-lo como serviço. Como tal, você tem três opções:

- Uma entrega -aaS por meio de uma API

- Uma opção hospedada na nuvem ou

- Uma opção auto-hospedada para implantações locais.

Opção 1: como serviço (aaS)

O modelo de API é talvez a abordagem mais direta para implementar reclassificadores. Eles estão disponíveis em soluções comerciais como Cohere e Jina. Este método permite que os desenvolvedores integrem recursos de reclassificação em seus pipelines RAG com sobrecarga mínima de infraestrutura. As soluções comerciais expõem endpoints de API onde os usuários enviam uma consulta junto com uma lista de documentos recuperados, e o serviço retorna esses documentos reordenados do mais para o menos semanticamente relevante. A arquitetura subjacente normalmente processa a entrada do usuário agrupando documentos e computando pontuações de relevância para cada segmento, com a pontuação final do documento determinada pelo bloco com pontuação mais alta.

Opção 2: implantações hospedadas na nuvem

Implantações hospedadas na nuvemIsso envolve a implantação de modelos de reclassificação por meio de plataformas de IA dos principais provedores de nuvem, combinando a robustez e a escalabilidade da infraestrutura em nuvem com o desempenho de modelos comerciais de reclassificação. Este método de implantação é particularmente benéfico para organizações que exigem desempenho consistente, escalonamento automático e integração com pipelines de dados existentes baseados em nuvem. Embora não seja tão conveniente quanto a opção de API, hospedar o modelo em sua nuvem minimiza a dependência do fornecedor terceirizado e pode cumprir quaisquer exigências de segurança, certificações de conformidade e acordos de nível de serviço.

Opção 3: implantações auto-hospedadas

Implantações auto-hospedadas permitir que as empresas executem modelos de reclassificação dentro de sua própria infraestrutura, de modo que nenhum dado precise ser processado por terceiros. Ele também oferece flexibilidade para personalizar configurações de implantação, otimizar hardware específico e integrar-se a sistemas empresariais existentes. Embora essa abordagem exija mais conhecimento técnico e gerenciamento de infraestrutura, ela oferece os benefícios da reclassificação em tempo real com latência mínima, ao mesmo tempo que mantém controle total sobre a privacidade dos dados e os protocolos de segurança.

Algumas das ferramentas de código aberto mais notáveis para reclassificação incluem o seguinte:

COLBERT é um modelo de recuperação rápido e preciso, permitindo pesquisa escalonável baseada em BERT em grandes coleções de texto em dezenas de milissegundos. Ele se baseia na interação tardia contextual refinada, codificando cada passagem em uma matriz de incorporações em nível de token. No momento da pesquisa, ele incorpora cada consulta em outra matriz e encontra com eficiência passagens que correspondem contextualmente à consulta usando operadores de similaridade vetorial escalável (MaxSim).

FlashRank usa reclassificadores Pairwise ou Listwise. É uma biblioteca Python que adiciona reclassificação aos pipelines de pesquisa e recuperação existentes.

ClassificaçãoZephyr é um modelo de linguagem grande (LLM) de código aberto para reclassificação listwise zero-shot. Ele é construído no modelo Zephyr-β de 7 bilhões de parâmetros (baseado em Mistral) e usa ajuste fino de instruções para destilar recursos de reclassificação de RankGPT-3.5 e RankGPT-4 sem exigir pares de relevância de passagem de consulta anotados por humanos.

Provedores de reclassificação comercial

Alguns exemplos de reclassificadores comerciais incluem Cohere e Jina.

Coheré O modelo de reclassificação emprega mecanismos de atenção cruzada para classificação refinada, permitindo a comparação direta de documentos de consulta que melhora significativamente a qualidade dos resultados para consultas complexas e subespecificadas. O modelo oferece recursos multilíngues, suportando mais de 100 idiomas e fornecendo recuperação precisa através das fronteiras linguísticas de conjuntos de dados internacionais e multilíngues. Ele pode lidar com formatos de dados corporativos complexos, classificando documentos multiaspectos e semiestruturados – incluindo e-mails, tabelas, JSON e código – com a mesma precisão que o texto tradicional de formato longo. A solução foi projetada para flexibilidade de implantação empresarial, oferecendo opções de implantação privada em nuvens privadas virtuais ou ambientes locais para máxima privacidade de dados e controle de segurança, ao mesmo tempo que está disponível por meio da plataforma da Cohere e de provedores de nuvem confiáveis.

Nome Reranker oferece recursos abrangentes de recuperação multilíngue em mais de 100 idiomas, permitindo a recuperação eficaz de documentos, independentemente do idioma de consulta utilizado. O modelo apresenta suporte especializado para chamadas de funções e recursos avançados de pesquisa de código, permitindo classificar trechos de código e assinaturas de funções com base em consultas de linguagem natural, tornando-o particularmente adequado para aplicativos Agentic RAG. Além disso, o Jina Reranker v2 fornece suporte robusto a dados tabulares e estruturados, classificando efetivamente as tabelas mais relevantes com base em consultas em linguagem natural e ajudando a classificar diferentes esquemas de tabelas para identificar o mais apropriado antes da geração de consultas SQL, tornando-o uma solução versátil para ambientes corporativos com diversos formatos de dados e requisitos multilíngues.

Como funciona a reclassificação

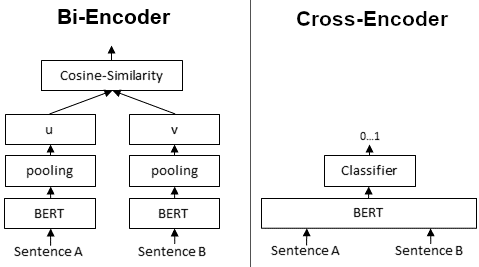

Bi-codificadores e codificadores cruzados são duas arquiteturas usadas no processamento de linguagem natural (PNL) para tarefas como similaridade, recuperação ou classificação de texto. Codificadores cruzados podem ser usados sempre que você tiver um conjunto predefinido de pares de frases que deseja pontuar. Por exemplo, você tem 100 pares de frases e deseja obter pontuações de similaridade para esses 100 pares.

Bi-codificadores são usados sempre que você precisar incorporar uma frase em um espaço vetorial para comparação eficiente. As aplicações são, por exemplo, Recuperação de Informação/Pesquisa Semântica ou Clustering.

Cross-Encoder alcança desempenho superior aos Bi-Encodersno entanto, eles não são bem dimensionados para grandes conjuntos de dados. Agrupar 10.000 frases com CrossEncoders exigiria o cálculo de pontuações de similaridade para cerca de 50 milhões de combinações de frases, o que leva cerca de 65 horas. Com um Bi-Encoder, você calcula a incorporação de cada frase, o que leva apenas 5 segundos.

Você pode combinar Cross- e Bi-Encoders. Por exemplo, você pode usar um Bi-Encoder eficiente para recuperar as 100 frases mais semelhantes para uma consulta e, em seguida, um Cross-Encoder para reclassificar essas 100 ocorrências, calculando a pontuação para cada combinação (consulta, ocorrência).

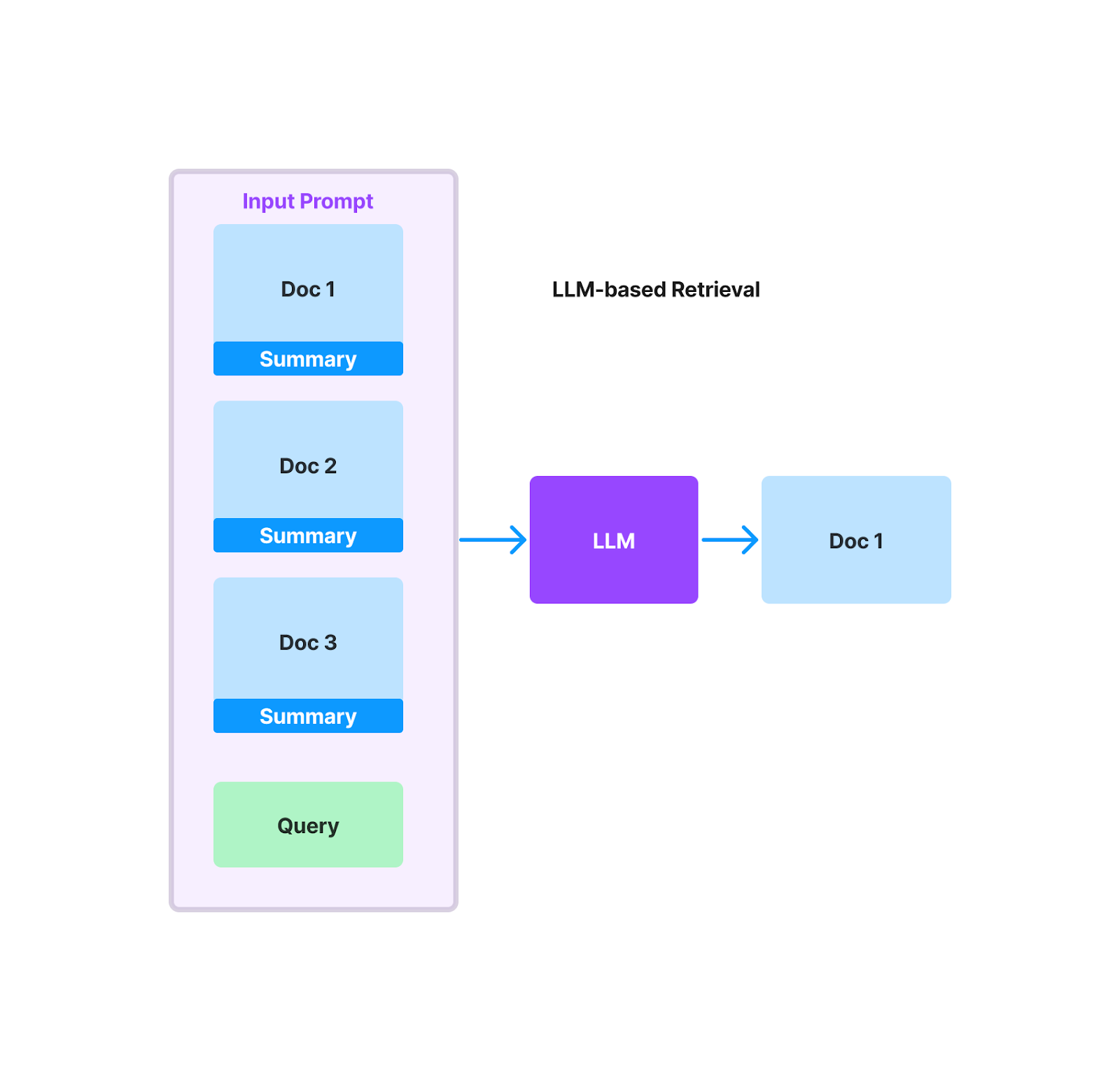

Reclassificação baseada em LLM

Assim como ao avaliar o RAG, você pode usar um LLM para reclassificar os documentos recuperados. A recuperação baseada em LLM pode retornar documentos mais relevantes do que a recuperação baseada em incorporação, com a desvantagem de latência e custo muito maiores. Em alto nível, essa abordagem usa o LLM para decidir quais documentos e partes são relevantes para uma determinada consulta. O prompt de entrada consistiria em um conjunto de documentos candidatos, e o LLM tem a tarefa de selecionar o conjunto relevante de documentos, bem como pontuar sua relevância com uma métrica interna.

Se você estiver usando o LlamaInde, o LLMRerank é uma estrutura preparada por módulo como parte da abstração NodePostprocessor.

Reclassificação em n8n

Você pode implementar facilmente a reclassificação em n8n usando o nó Reclassificador Cohere. Ele permite que os usuários reclassifiquem os pedaços resultantes de um armazenamento de vetores. Você pode conectar este nó a um armazenamento de vetores. O reclassificador reordena a lista de documentos recuperados de um armazenamento de vetores para uma determinada consulta em ordem decrescente de relevância.

Esse Chatbot de IA inteligente com RAG e Cohere Reranker O modelo de fluxo de trabalho cria um assistente de IA inteligente que combina RAG com a tecnologia de reclassificação da Cohere para garantir que as informações mais relevantes sejam priorizadas.